No campo da inteligência artificial, os modelos de linguagem de grande escala, conhecidos como LLMs, se tornaram ferramentas indispensáveis para a automação e processamento de linguagem natural (NLP). Desde o lançamento de estruturas como GPT, PaLM e Claude, a indústria tem testemunhado avanços significativos em como essas arquiteturas são implementadas e aplicadas.

Arquitetura e Funcionamento

Os LLMs, fundamentados em redes neurais profundas, utilizam camadas de transformadores para processar e gerar texto de forma coerente e contextual. A estrutura básica envolve embeddings que transformam palavras em vetores, camadas de atenção que destacam relações semânticas importantes e uma série de camadas feed-forward que refinam as saídas. Por exemplo, o modelo GPT (Generative Pre-trained Transformer) se concentra em um mecanismo robusto de atenção, permitindo-lhe prever a próxima palavra em uma sequência de texto.

Análise Comparativa

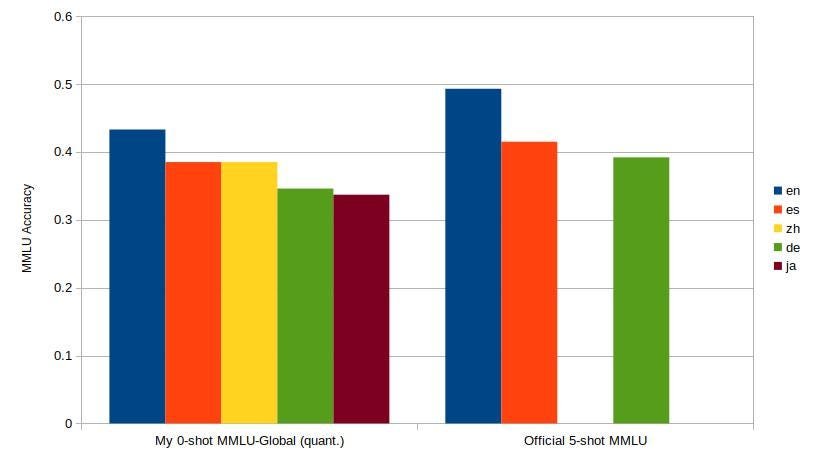

Os principais players no campo, como GPT e PaLM, são frequentemente comparados usando métricas de benchmarking, como o GLUE para entendimento de linguagem geral ou Global-MMLU para avaliação multilingue. Um estudo recente do Instituto Brasileiro de Inteligência Artificial destacou que, enquanto GPT-3 apresenta maior versatilidade em tasks generalistas, modelos como Claude têm se sobressaído em tarefas específicas devido a otimizações contextuais.

Aspectos Práticos

No Brasil, o uso de LLMs está se expandindo em setores como atendimento ao cliente, análise de sentimento e automação de documentos legais. Modelos treinados com dados específicos e cultura local podem oferecer insights mais profundos e relevantes. Empresas estão explorando o uso de LLMs para melhorar a interação com clientes, criando assistentes virtuais capaz de lidar com nuances culturais e linguísticas específica.

Considerações Técnicas

Embora as capacidades dos LLMs sejam extraordinárias, eles não estão isentos de limitações. A opacidade de suas decisões, o consumismo computacional e questões de viés ético são preocupações reais. Um olhar técnico revela a necessidade de ajustes contínuos e otimizações para garantir eficiência e equidade.

Recomendações de Uso

Ao buscar implementar LLMs, é crucial seguir guidelines práticas: treinar com dados diversificados, validar com benchmarks locais e otimizar para eficiência energética. A implementação ética também deve ser uma prioridade, com auditorias regulares para identificar e corrigir vieses.

Pontos de Atenção

- Entendimento profundo das capacidades e limitações técnicas dos LLMs

- Avaliação de performance baseada em tarefas específicas

- Mitigação de preconceitos e vieses no modelo

- Otimização constante para melhorar a eficiência e a eficácia

- Exploração contínua de avanços técnicos e metodológicos

“Os LLMs estão redefinindo o processamento de linguagem natural, mas é fundamental que os utilizadores compreendam suas limitações e contextos de uso para maximizar seu potencial.” — Instituto Brasileiro de Inteligência Artificial